この記事の要点

この記事の重要ポイント

- 1

Sovereign Intelligence

- 2

Privacy:上传到 ChatGPT 的数据,有被用于学习的可能性。如果要喂公司机密文档,或私人的日记,只能选本地环境 (Local LLM)

- 3

Mac Studio (M2/M3 Ultra):能搭载最大 192GB 的统一内存。这意味这什么?意味着光靠 GPU 内存就能运行 70B (700 亿参数) 级的巨大 LLM。虽然推理速度不是爆速,但能处理的模型尺寸是不同数量级

- 4

NVIDIA GeForce RTX 4090:不仅是推理 (Inference),如果也想学习 (Training/Fine-tuning) 的话就是 NVIDIA。CUDA 生态系统是绝对王者,最新的论文总是被写成如果在 NVIDIA 上动

- 5

Latency:因为不经过云端,所以响应是瞬间的。能以思考的速度对话

引言:智能的所有权

电,水,气。 然后是“智能”。 AI 成了第 4 个基础设施。

但是,持续依赖 OpenAI 和 Google 是风险。 如果他们说“违反策略”,你的脑就停止。 在家里放服务器,跑开源 LLM (Llama 3 或 Mistral)。 那是,数字时代的“武装”。

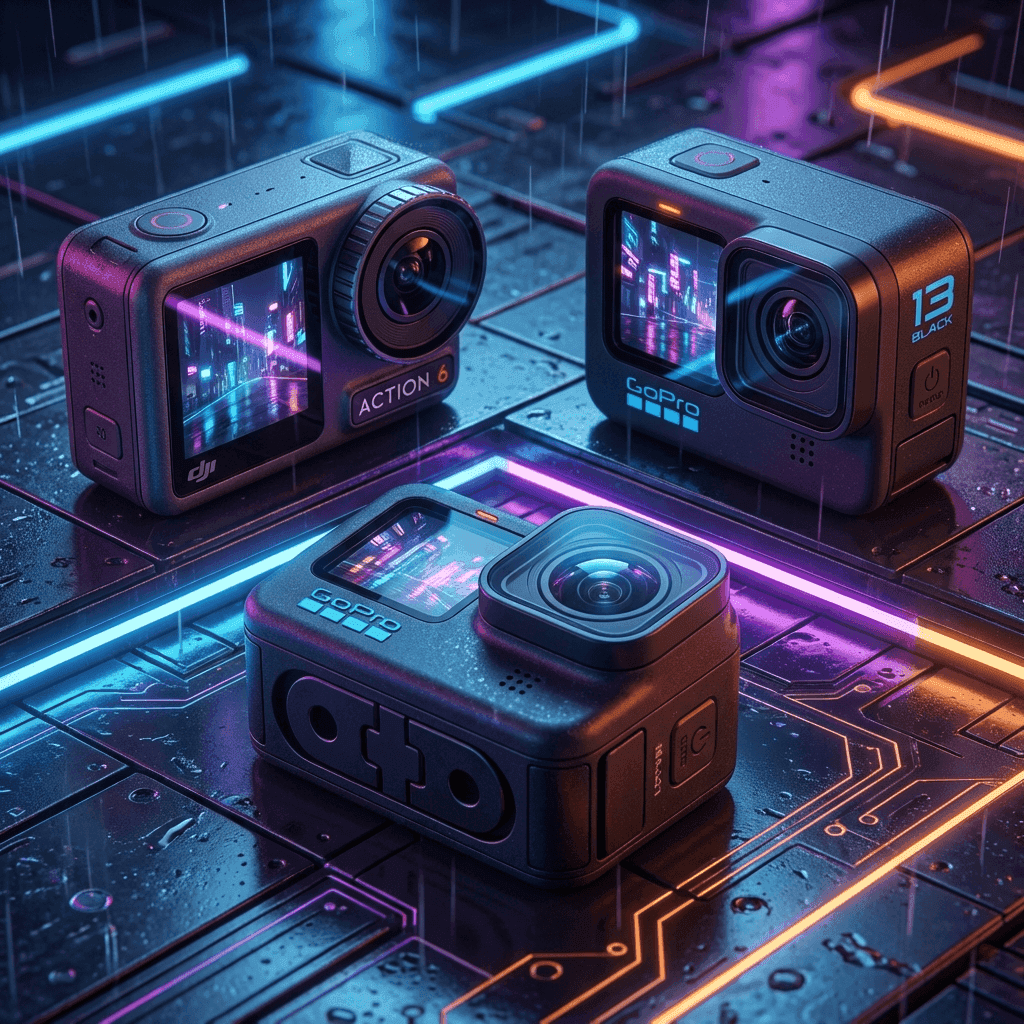

1. The Inference Monster: Mac Studio

Apple Silicon,在 AI 业界掀起了革命。 多亏了共享 VRAM (视频内存) 和主内存的“统一内存”,能以 100 万日元以下获得拥有 192GB VRAM 的机器。 如果在 NVIDIA 做同样的事,需要 H100 (数百万日元)。

LLM Studio

如果使用“LM Studio”或“Ollama”,一条命令本地 AI 就会启动。 即使切断 Wi-Fi,你也能和全知全能的 AI 对话。

2. The Training Beast: RTX 4090 Workstation

如果想自己培育 AI (Fine-tuning),由于绿色巨人 (NVIDIA) 是必须的。 依靠 CUDA 核心的暴力的计算能力,LoRA (追加学习) 几十分钟就结束。

GIGABYTE GeForce RTX 4090

VRAM 是 24GB。虽然比 Mac 少,但速度是压倒性的。如果要运行图像生成 AI (Stable Diffusion),比 Mac 快数倍。

3. Comparison: 量,还是速

| 項目 | Mac Studio (Ultra) | RTX 4090 PC |

|---|---|---|

| VRAM (内存) | 最大 192GB (超大) | 24GB (小) |

| 可运行模型 | Llama-3-70B (游刃有余) | Llama-3-8B (极限) |

| 生成速度 | 快 (50 t/s) | 爆速 (100 t/s) |

| 用途 | 推理・聊天 | 学习・图像生成 |

4. The Edge of Network

请把这个“硅之脑”,用 VPN (Tailscale) 向外部公开。 从外出的 iPhone,连接自家的最强 PC,向私人的 AI 提问。 数据一切,不渡给巨大科技企业。

结论:只属于你的执手

在谁也没看的地方,说什么都可以。 即使问怎样危险的问题,也不会被 BAN。 然后,尽知你的个人秘密 (日记,财务状况,代码库)。

拥有那样的 AI,是现代最强的特权。 买 Mac Studio 吧。 那,不仅仅是 PC,而是“智能的器皿”。

⚠️ コメントのルール

※違反コメントはAIおよび管理者により予告なく削除されます

まだコメントがありません。最初のコメントを投稿しましょう!