この記事の要点

この記事の重要ポイント

- 1

Sovereign Intelligence

- 2

Privacy:ChatGPTにアップロードしたデータは、学習に使われる可能性がある。社外秘のドキュメントや、プライベートな日記を食わせるなら、ローカル環境(Local LLM)一択だ

- 3

Mac Studio (M2/M3 Ultra):ユニファイドメモリが最大192GB搭載できる。これが何を意味するか? 70B(700億パラメータ)クラスの巨大なLLMを、GPUメモリだけで動かせるということだ。推論速度は爆速ではないが、扱えるモデルのサイズが桁違いだ

- 4

NVIDIA GeForce RTX 4090:推論(Inference)だけでなく、学習(Training/Fine-tuning)もしたいならNVIDIAだ。CUDAエコシステムは絶対王者であり、最新の論文は常にNVIDIAで動くように書かれている

- 5

Latency:クラウドを経由しないため、応答は瞬時だ。思考の速度で対話できる

はじめに: 知能の所有権

電気、水、ガス。 そして「知能」。 AIは第4のインフラになりました。

しかし、OpenAIやGoogleに依存し続けるのはリスクです。 彼らが「ポリシー違反」と言えば、あなたの脳は停止します。 自宅にサーバーを置き、オープンソースのLLM(Llama 3やMistral)を走らせること。 それは、デジタル時代の「武装」です。

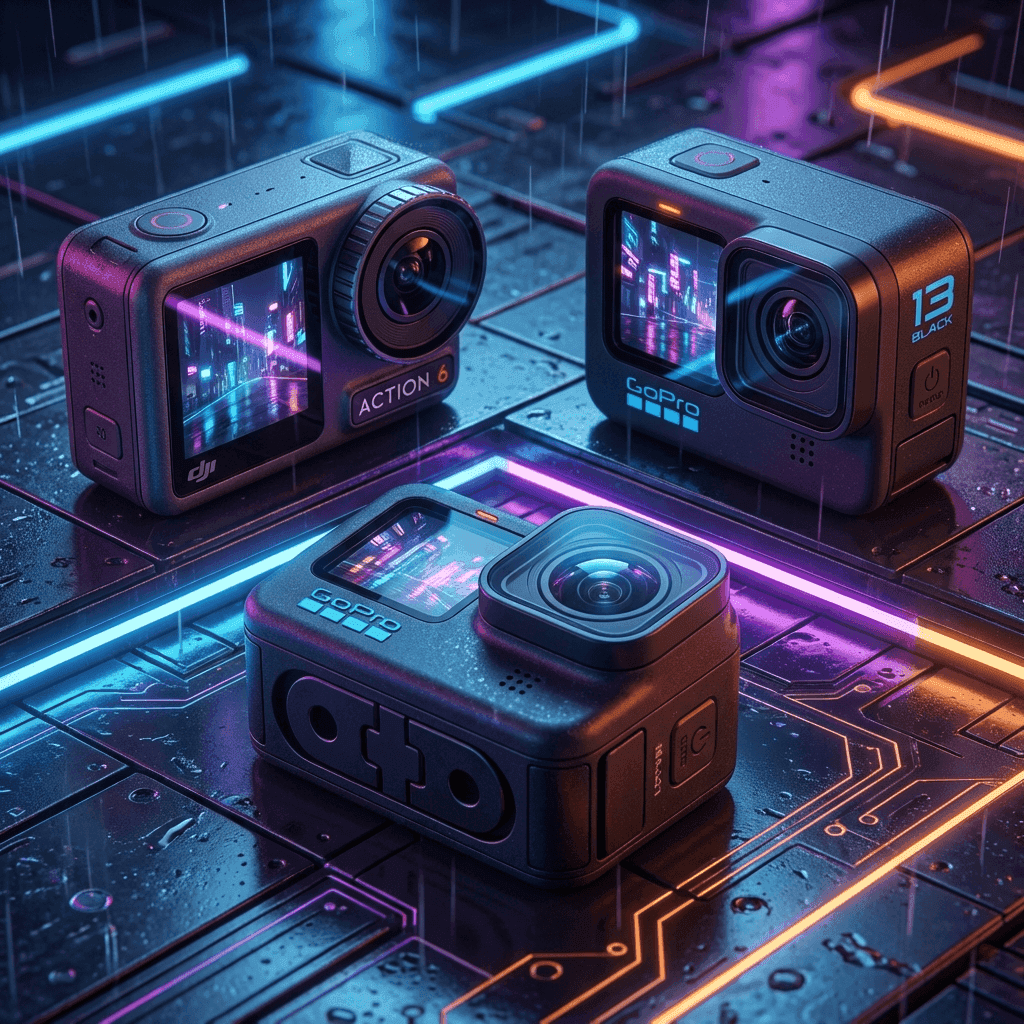

1. The Inference Monster: Mac Studio

Appleシリコンは、AI業界に革命を起こしました。 VRAM(ビデオメモリ)とメインメモリを共有する「ユニファイドメモリ」のおかげで、100万円以下で192GBのVRAMを持つマシンが手に入ります。 NVIDIAで同じことをしようとすると、H100(数百万円)が必要です。

Apple Mac Studio (M2 Ultra)

静音性が素晴らしい。70Bモデルを動かしていても、ファンの音はほとんど聞こえない。電気代も安い。推論専用機としては世界コスパ最強。

LLM Studio

「LM Studio」や「Ollama」を使えば、コマンド一発でローカルAIが立ち上がります。 Wi-Fiを切っても、あなたは全知全能のAIと対話できます。

2. The Training Beast: RTX 4090 Workstation

自分でAI育てたい(Fine-tuning)なら、緑の巨人(NVIDIA)が必要です。 CUDAコアの暴力的な計算能力により、LoRA(追加学習)が数十分で終わります。

GIGABYTE GeForce RTX 4090

VRAMは24GB。Macに比べると少ないが、速度は圧倒的。画像生成AI(Stable Diffusion)を動かすなら、Macの数倍速い。

3. Comparison: 量か、速さか

| 項目 | Mac Studio (Ultra) | RTX 4090 PC |

|---|---|---|

| VRAM (メモリ) | 最大192GB (超大) | 24GB (小) |

| 実行可能モデル | Llama-3-70B (余裕) | Llama-3-8B (限界) |

| 生成速度 | 速い (50 t/s) | 爆速 (100 t/s) |

| 用途 | 推論・チャット | 学習・画像生成 |

4. The Edge of Network

この「シリコンの脳」を、VPN(Tailscale)で外部公開してください。 外出先のiPhoneから、自宅の最強PCに接続し、プライベートなAIに質問する。 データは一切、巨大テック企業に渡りません。

結論: あなただけの執事

誰も見ていないところで、何を話してもいい。 どんな際どい質問をしても、BANされることはない。 そして、あなたの個人的な秘密(日記、財務状況、コードベース)を知り尽くしている。

そんなAIを持つことは、現代における最強の特権です。 Mac Studioを買いましょう。 それは、ただのPCではなく「知能の器」です。

⚠️ コメントのルール

※違反コメントはAIおよび管理者により予告なく削除されます

まだコメントがありません。最初のコメントを投稿しましょう!